Sommaire

💡 Astuce IA : créez vos outils d'apprentissage interactifs avec les artefacts Claude

Les artefacts Claude sont une révolution pour l'apprentissage et la productivité. Ils permettent de créer des outils interactifs utilisables immédiatement : quiz, calculateurs, formulaires, tableaux de bord, simulateurs...

Qu'est-ce qu'un artefact Claude ?

Quand vous demandez à Claude de créer quelque chose d'interactif (code, document structuré, outil), il génère un artefact séparé que vous pouvez :

Utiliser directement dans l'interface

Modifier en temps réel

Exporter/partager

Réutiliser dans d'autres contextes

C'est comme avoir un développeur + designer qui crée vos outils sur-mesure en quelques secondes.

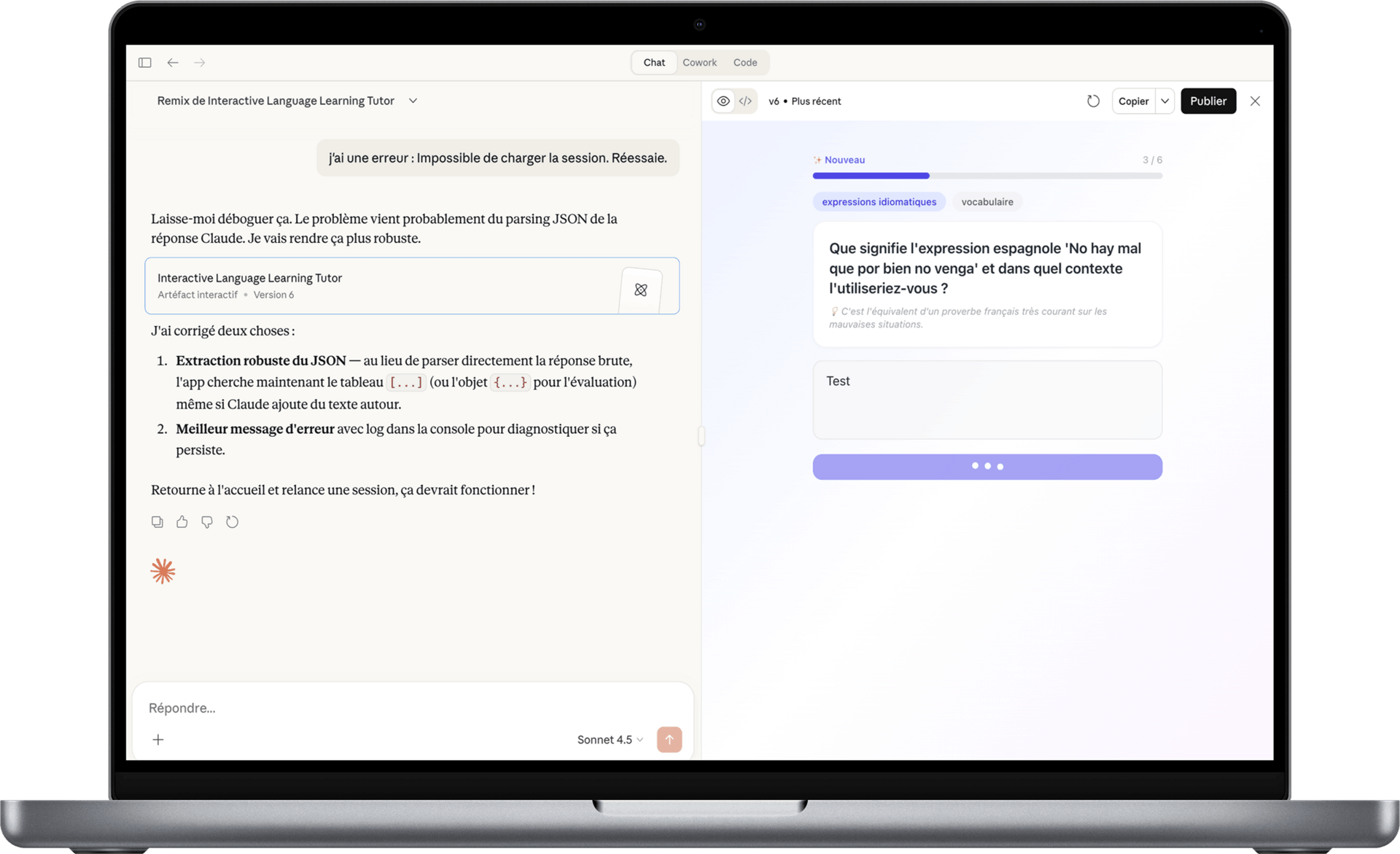

Exemple concret : créer un quiz d'espagnol interactif

Prompt à utiliser :

"Crée-moi une application web de quiz interactif et évolutive pour apprendre l'espagnol niveau débutant. Des questions générées par l’IA à la volée s’adaptant à mon niveau sur les verbes courants (ser, estar, tener, ir). Format QCM avec 4 choix. Affiche le score à la fin avec un message d'encouragement. Design moderne et coloré."

Résultat en 20 secondes :

Claude génère un artefact (ici app web) HTML complet, fonctionnel, que vous pouvez utiliser immédiatement. Vous testez, vous ajustez ("ajoute des explications pour chaque bonne réponse"), et c'est prêt. C’est une nouvelle manière de créer les MVP (Produit Minimum Viable) pour penser, créer instantanément un prototype et tester rapidement le marché.

🎁 Testez un exemple :

J'ai créé un quiz avec quelques questions sur votre niveau en IA, testez la ici :

ATTENTION IL FAUT AVOIR UN COMPTE CLAUDE

Conseil actionnable cette semaine

Testez les artefacts Claude sur UN besoin concret :

Identifiez un outil qui vous manque (quiz, calculateur, tableau...)

Décrivez-le précisément à Claude en incluant :

L'objectif ("pour former mes collaborateurs à...")

Le format ("calculateur avec 3 entrées"...)

Le design ("moderne", "professionnel", "coloré"...)

Testez l'artefact généré

Construisez de manière hyper itérative un prototype fonctionnel (IHM, fonctionnalités, données …)

Ajustez en demandant des modifications ("ajoute...", "modifie...", "simplifie...")

Résultat garanti : vous aurez créé un outil professionnel testable immédiatement, sans compétences techniques.

💡 Astuce bonus : Utilisez artefact pour prototyper vos apps puis Claude code et Cursor pour les convertir en de vrais logiciels indépendants.

📚 Définition : qu'est-ce qu'une hallucination en IA ?

Une hallucination en intelligence artificielle désigne le phénomène où un modèle génère des informations fausses, inventées ou non vérifiables avec une apparence de véracité et de confiance.

Différence avec une erreur classique :

Erreur classique : l'IA se trompe sur une information existante (ex: "Paris a 3 millions d'habitants" au lieu de 2,2)

Hallucination : l'IA invente de toutes pièces une information qui n'existe pas (ex: "Le Prix Nobel de l'IA a été décerné à Marc Dupont en 2024" - cette personne et ce prix n'existent pas)

Pourquoi les IA hallucinent-elles ?

Les modèles d'IA générative (ChatGPT, Claude, Gemini) sont entraînés à prédire la suite la plus probable d'un texte, pas à dire la vérité. Si une question ressemble à quelque chose qu'ils ont vu dans leurs données d'entraînement, ils peuvent générer une réponse "plausible" même sans connaître la vraie réponse.

Exemples concrets d'hallucinations :

Hallucination de citation :

"Einstein a dit : 'L'IA est la dernière invention de l'humanité'" → Einstein est mort en 1955, bien avant l'IA moderne

Hallucination de source :

"Selon une étude de l'université de Stanford publiée en 2025..." → l'étude n'existe pas, mais le format semble crédible

Hallucination technique :

"Pour résoudre ce bug, exécute la commande npm install --fix-quantum" → cette commande n'existe pas

Comment détecter et éviter les hallucinations ?

✅ Vérifiez systématiquement les sources : demandez à l'IA de citer ses sources, puis vérifiez-les sur les sites officiels

✅ Croisez les informations : posez la même question à plusieurs modèles (ChatGPT, Claude, Gemini) et comparez les réponses

✅ Soyez critique sur les détails précis : dates, noms propres, chiffres, citations sont les zones à haut risque d'hallucination

✅ Utilisez les modes avec recherche web : ChatGPT avec navigation, Gemini, ou Perplexity accèdent à des sources actualisées et vérifiables

✅ Utilisez des techniques où vous précisez les sources : Demandez au LLM d’indiquer lorsqu’il prend des hypothèses. Chargez les données en entrées avec Gemini par exemple qui a une fenêtre de contexte de plus d’un million de tokens.

Pourquoi c'est important en 2026 :

Avec la démocratisation de l'IA, les hallucinations deviennent un enjeu de fiabilité professionnelle. Une décision stratégique basée sur une information hallucinée peut coûter cher. Savoir identifier et prévenir les hallucinations est devenu une compétence aussi importante que savoir utiliser l'IA elle-même.

Dans nos formations MaCertif, nous enseignons justement à utiliser l'IA de manière critique et responsable pour minimiser ces risques.

🗞️ Actualité : L'IA bouleverse notre rapport au vrai et au faux : comment s'adapter ?

Ce qui se passe :

Une enquête approfondie du Monde révèle comment l'IA générative a transformé notre écosystème informatif en un an. Vidéos ultra-réalistes (Sora), information personnalisée (ChatGPT), fact-checking instantané (Grok)... Nous vivons une ère d'immédiateté et d'abondance, mais aussi de doute permanent.

Pourquoi c'est crucial pour vous :

Nous sommes tous concernés : professionnels, managers, formateurs, étudiants. L'IA crée un paradoxe :

✅ Plus d'accès à l'information que jamais

❌ Plus difficile de distinguer le vrai du faux

3 réflexes à adopter dès maintenant :

1. Vérifiez systématiquement les sources

Ne prenez jamais une information générée par IA pour argent comptant. Demandez toujours les sources, vérifiez sur les sites officiels.

2. Utilisez l'IA pour fact-checker... l'IA

Paradoxal mais efficace : demandez à un modèle de vérifier l'information d'un autre et retrouver les sources par une autre IA. Exemple :

"ChatGPT me dit que X. Peux-tu vérifier cette info sur des sources fiables et me dire si c'est exact ?"

3. Développez votre esprit critique numérique

Posez-vous systématiquement : "Quelle est la source ?", "Cette vidéo/image peut-elle être générée par IA ?", "Cette info est-elle trop belle pour être vraie ?", “Cette information est-elle diffusée par des médias reconnus pour vérifier leurs sources ?”

Mon analyse de formateur :

Cette transformation n'est pas une fatalité, c'est une opportunité de devenir plus intelligent dans notre consommation d'information. Les professionnels qui maîtrisent ces réflexes prennent un avantage compétitif : ils évitent les erreurs coûteuses basées sur de fausses informations.

Source : Le Monde - Lire l'article complet

🔍 Analyse : l'ère de la spécialisation et du multi-outil

Le changement de paradigme 2026

Nous assistons à un basculement majeur : après la course à la puissance généraliste (2023-2024), l'IA entre dans l'ère de la spécialisation stratégique.

Ce que ça signifie concrètement :

Avant (2023-2024) :

"J'utilise ChatGPT pour tout"

Maintenant (2026) :

"J'utilise ChatGPT pour X, Claude pour Y, Gemini pour Z, selon mes besoins"

Pourquoi c'est une révolution pour les professionnels

1. Vous gagnez en précision

Chaque outil excelle dans son domaine. Vous obtenez de meilleurs résultats en choisissant le bon outil.

2. Vous réduisez les erreurs

Claude avec ses artefacts pour créer des outils, ChatGPT pour la créativité, Gemini pour la recherche web actualisée : chacun minimise les hallucinations dans son domaine.

3. Vous devenez plus autonome

Au lieu de dépendre d'un seul fournisseur, vous composez votre propre "stack IA" adaptée à votre métier.

Projection 12-18 mois :

Les professionnels les plus performants ne seront pas ceux qui maîtrisent UN outil, mais ceux qui savent orchestrer plusieurs IA spécialisées selon le contexte.

C'est exactement ce que nous enseignons chez MaCertif : une vision d'ensemble multi-outils pour naviguer dans cet écosystème en évolution constante.

🧭 Pour aller plus loin – Formation MaCertif

"Maîtriser ChatGPT, Mistral, Gemini et autres modèles"

La formation la plus complète en français pour comprendre et maîtriser l'IA Générative dans un contexte professionnel.

🎓 Une certification reconnue pour renforcer votre CV

À l'issue de la formation, vous passez la certification RS6776 : "Création de contenus par l'usage responsable de l'IA générative"

✅ Reconnue par France Compétences (État français)

✅ Valorisable sur CV et LinkedIn

✅ Financement CPF possible (en France)

✅ Paiement fractionné sans frais (facilité de paiement sans frais)

✅ Recherchée par les recruteurs en 2026

💭 Mot de la fin

✅ Les artefacts Claude révolutionnent la création d'outils : testez-les sur un besoin concret cette semaine

✅ Hallucination IA : apprenez à les détecter en vérifiant systématiquement sources et informations précises

✅ L'IA bouleverse le vrai/faux : adoptez les 3 réflexes de vérification systématique

✅ Claude s'impose comme alternative : testez-le gratuitement et comparez avec ChatGPT sur vos cas d'usage

✅ L'approche multi-outils devient stratégique : ne vous enfermez pas dans un seul écosystème

La question n'est plus "quel est le meilleur outil IA ?" mais "quel outil pour quelle tâche dans MON contexte ?"

Bonne nouvelle : vous pouvez tester gratuitement tous ces outils cette semaine. Commencez par créer un artefact interactif avec Claude, vous serez bluffé.

À la semaine prochaine ! 🚀

Grégoire SEMELET

Ou copiez le lien pour LinkedIn : {{live_url}}